CowAgent 是基于大模型的超级 AI 助理,能够主动思考和任务规划、操作计算机和外部资源、创造和执行 Skills、拥有长期记忆和知识库并不断成长,比 OpenClaw 更轻量和便捷。CowAgent 支持灵活切换多种模型,能处理文本、语音、图片、文件等多模态消息,可接入微信、飞书、钉钉、企微智能机器人、QQ、企微自建应用、微信公众号、网页中使用,7*24小时运行于你的个人电脑或服务器中。

该项目既是一个可以开箱即用的超级 AI 助理,也是一个支持高扩展的 Agent 框架,可以通过为项目扩展大模型接口、接入渠道、内置工具、Skills 系统来灵活实现各种定制需求。核心能力如下:

- ✅ 自主任务规划:能够理解复杂任务并自主规划执行,持续思考和调用工具直到完成目标

- ✅ 长期记忆: 自动将对话记忆持久化至本地文件和数据库中,包括核心记忆、日级记忆和梦境蒸馏,支持关键词及向量检索

- ✅ 个人知识库: 自动整理结构化知识,通过交叉引用构建知识图谱,支持通过对话管理和可视化浏览知识库

- ✅ 技能系统: Skills 安装和运行的引擎,支持从 Skill Hub、GitHub 等一键安装技能,或通过对话创造 Skills

- ✅ 工具系统: 内置文件读写、终端执行、浏览器操作、定时任务等工具,Agent 自主调用以完成复杂任务

- ✅ CLI系统: 提供终端命令和对话命令,支持进程管理、技能安装、配置修改等操作

- ✅ 多模态消息: 支持对文本、图片、语音、文件等多类型消息进行解析、处理、生成、发送等操作

- ✅ 多模型支持: 支持 DeepSeek、MiniMax、Claude、Gemini、OpenAI、GLM、Qwen、Doubao、Kimi 等国内外主流模型厂商

- ✅ 多通道接入: 支持运行在本地计算机或服务器,可集成到微信、飞书、钉钉、企业微信、QQ、微信公众号、网页中使用

🚀 快速开始

项目提供了一键安装、配置、启动、管理程序的脚本,推荐使用脚本快速运行,也可以根据下文中的详细指引一步步安装运行。

在终端执行以下命令:

Linux / macOS:

bash <(curl -fsSL https://cdn.link-ai.tech/code/cow/run.sh)

Windows(PowerShell):

irm https://cdn.link-ai.tech/code/cow/run.ps1 | iex

脚本使用说明:一键运行脚本。安装后可使用 cow start、cow stop 等 CLI 命令 管理服务。

一、准备

1. 模型API

项目支持国内外主流厂商的模型接口,可选模型及配置说明参考:模型说明。

注:Agent 模式下推荐使用以下模型,可根据效果及成本综合选择:deepseek-v4-flash、MiniMax-M2.7、glm-5.1、kimi-k2.6、qwen3.5-plus、claude-sonnet-4-6、gemini-3.1-pro-preview、gpt-5.4、gpt-5.4-mini

同时支持使用 LinkAI 平台 接口,支持上述全部模型,并支持知识库、工作流、插件等 Agent 技能,参考 接口文档。

2.环境安装

支持 Linux、MacOS、Windows 操作系统,可在个人计算机及服务器上运行,需安装 Python,Python 版本需在 3.7 ~ 3.13 之间。

注意:Agent 模式推荐使用源码运行,若选择 Docker 部署则无需安装 python 环境和下载源码,可直接快进到下一节。

(1) 克隆项目代码:

git clone https://github.com/zhayujie/CowAgent

cd CowAgent/

若遇到网络问题可使用国内仓库地址:https://gitee.com/zhayujie/CowAgent

(2) 安装核心依赖 (必选):

pip3 install -r requirements.txt

(3) 拓展依赖 (可选,建议安装):

pip3 install -r requirements-optional.txt

国内网络可使用镜像源加速:

pip3 install -r requirements.txt -i https://pypi.tuna.tsinghua.edu.cn/simple

如果某项依赖安装失败可注释掉对应的行后重试。

(4) 安装 Cow CLI (推荐):

pip3 install -e .

安装后可使用 cow 命令管理服务(启动、停止、更新等)和技能,详见 命令文档。

(5) 安装浏览器工具 (可选):

如果需要 Agent 操作浏览器(如访问网页、填写表单等),需要额外安装浏览器依赖:

cow install-browser

该命令会自动安装 playwright 和 Chromium 浏览器,国内网络自动使用镜像加速。详见 浏览器工具文档。

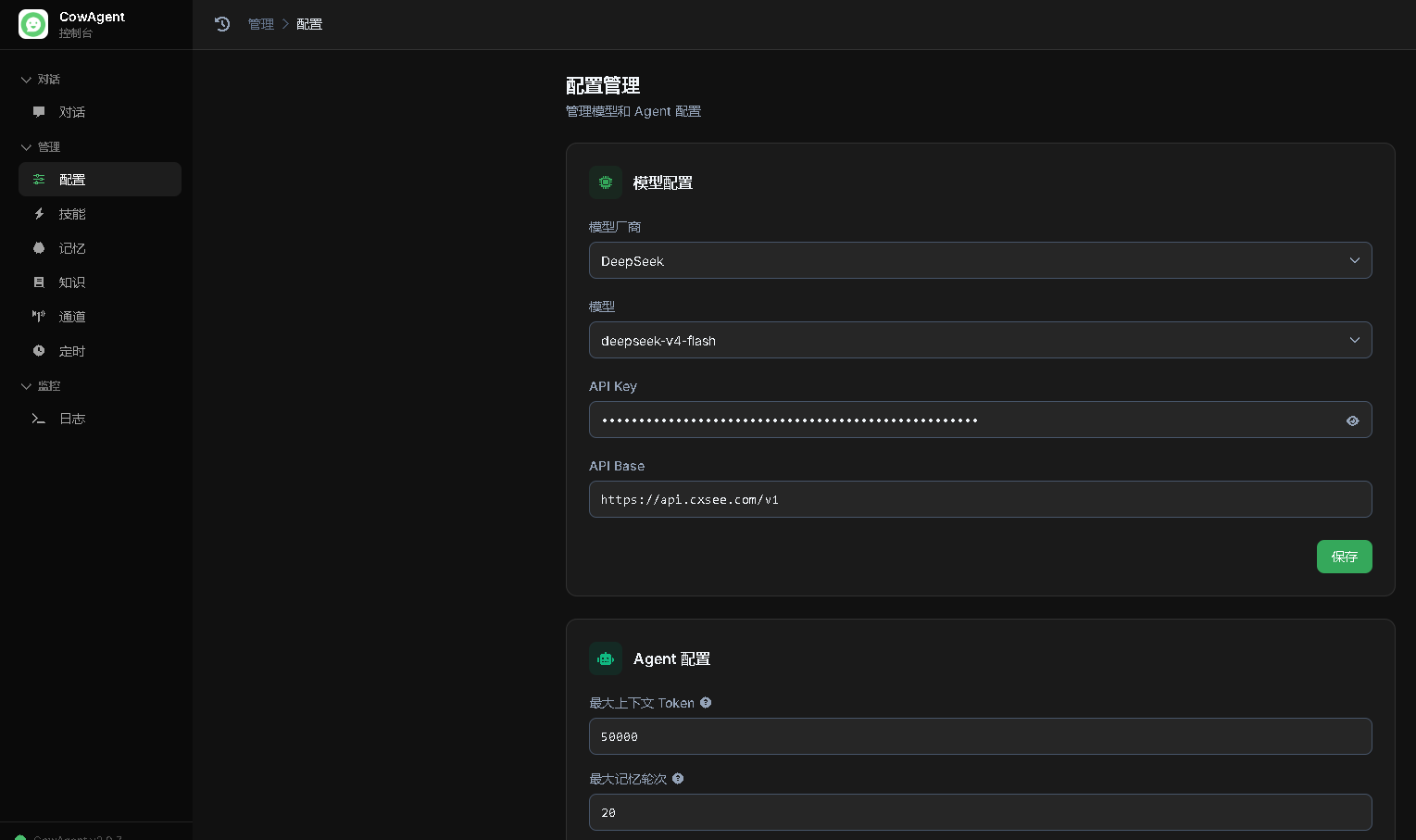

二、配置

配置文件的模板在根目录的 config-template.json 中,需复制该模板创建最终生效的 config.json 文件:

cp config-template.json config.json

然后在 config.json 中填入配置,以下是对默认配置的说明,可根据需要进行自定义修改(注意实际使用时请去掉注释,保证 JSON 格式的规范):

# config.json 文件内容示例

{

"channel_type": "weixin", # 接入渠道类型,默认为 weixin, 支持修改为 feishu,dingtalk,wecom_bot,qq,wechatcom_app,wechatmp_service,wechatmp,terminal

"model": "deepseek-v4-flash", # 模型名称

"deepseek_api_key": "", # DeepSeek API Key

"deepseek_api_base": "https://api.cxsee.com/v1", # DeepSeek API 地址

"minimax_api_key": "", # MiniMax API Key

"zhipu_ai_api_key": "", # 智谱 GLM API Key

"moonshot_api_key": "", # Kimi/Moonshot API Key

"ark_api_key": "", # 豆包(火山方舟) API Key

"dashscope_api_key": "", # 百炼(通义千问) API Key

"claude_api_key": "", # Claude API Key

"claude_api_base": "https://api.cxsee.com/v1", # Claude API 地址,修改可接入三方代理平台

"gemini_api_key": "", # Gemini API Key

"gemini_api_base": "https://api.cxsee.com", # Gemini API 地址

"open_ai_api_key": "", # OpenAI API Key

"open_ai_api_base": "https://api.cxsee.com/v1", # OpenAI API 地址

"linkai_api_key": "", # LinkAI API Key

"proxy": "", # 代理客户端的 ip 和端口,国内环境需要开启代理的可填写该项,如 "127.0.0.1:7890"

"speech_recognition": false, # 是否开启语音识别

"group_speech_recognition": false, # 是否开启群组语音识别

"voice_reply_voice": false, # 是否使用语音回复语音

"use_linkai": false, # 是否使用 LinkAI 接口,默认关闭,设置为 true 后可对接 LinkAI 平台模型

"web_password": "", # Web 控制台访问密码,留空则不启用密码保护

"agent": true, # 是否启用 Agent 模式,启用后拥有多轮工具决策、长期记忆、Skills 能力等

"agent_workspace": "~/cow", # Agent 的工作空间路径,用于存储 memory、skills、系统设定等

"agent_max_context_tokens": 50000, # Agent 模式下最大上下文 tokens,超出将自动智能压缩处理

"agent_max_context_turns": 20, # Agent 模式下最大上下文记忆轮次,一问一答为一轮,超出后智能压缩处理

"agent_max_steps": 20, # Agent 模式下单次任务的最大决策步数,超出后将停止继续调用工具

"enable_thinking": false # 是否启用深度思考模式

}

配置补充说明:

1. 语音配置

2. 其他配置

3. LinkAI 配置

注:全部配置项说明可在 config.py 文件中查看。

三、运行

1.本地运行

如果是个人计算机 本地运行,直接在项目根目录下执行:

cow start # 推荐,需先安装 Cow CLI

python3 app.py # 或直接运行,windows 环境下该命令通常为 python app.py

运行后默认会启动 web 服务,可通过访问 http://localhost:9899/chat 在网页端对话。

如果需要接入其他应用通道只需修改 config.json 配置文件中的 channel_type 参数,详情参考:通道说明。

2.服务器部署

推荐使用 cow 命令管理服务:

cow start # 后台启动

cow stop # 停止服务

cow restart # 重启服务

cow status # 查看运行状态

cow logs # 查看日志

cow update # 拉取最新代码并重启

也可以使用传统方式后台运行:

nohup python3 app.py & tail -f nohup.out

此外,项目根目录下的 run.sh 脚本也支持一键管理服务,包括 ./run.sh start、./run.sh stop、./run.sh restart 等命令,执行 ./run.sh help 可查看全部用法。

如果需要通过浏览器访问 Web 控制台,请确保服务器的

9899端口已在防火墙或安全组中放行,建议仅对指定 IP 开放以保证安全。

3.Docker部署

使用 docker 部署无需下载源码和安装依赖,只需要获取 docker-compose.yml 配置文件并启动容器即可。Agent 模式下更推荐使用源码进行部署,以获得更多系统访问能力。

前提是需要安装好

docker及docker-compose,安装成功后执行docker -v和docker-compose version(或docker compose version) 可查看到版本号。安装地址为 docker官网 。

(1) 下载 docker-compose.yml 文件

curl -O https://cdn.link-ai.tech/code/cow/docker-compose.yml

下载完成后打开 docker-compose.yml 填写所需配置,例如 CHANNEL_TYPE、OPEN_AI_API_KEY 和等配置。

(2) 启动容器

在 docker-compose.yml 所在目录下执行以下命令启动容器:

sudo docker compose up -d # 若docker-compose为 1.X 版本,则执行 `sudo docker-compose up -d`

运行命令后,会自动取 docker hub 拉取最新 release 版本的镜像。当执行 sudo docker ps 能查看到 NAMES 为 chatgpt-on-wechat 的容器即表示运行成功。最后执行以下命令可查看容器的运行日志:

sudo docker logs -f chatgpt-on-wechat

如果需要通过浏览器访问 Web 控制台,请确保服务器的

9899端口已在防火墙或安全组中放行,建议仅对指定 IP 开放以保证安全。

API接口只需要更改为第三方接口更方便,网址+令牌https://api.cxsee.com/v1 如何获取接口网址及令牌

可通过对话执行命令

很多服务器Python 版本太老(3.6),导致 aiohttp 在你当前环境只能走源码构建,进而触发 setup.py 依赖问题。

核心建议:不要再用 Python 3.6,升级到 3.10/3.11 并使用虚拟环境安装。

在CentOS系统可直接执行的命令:

一、安装 Python 3.10(不覆盖系统 Python)

yum -y update

yum -y install gcc openssl-devel bzip2-devel libffi-devel zlib-devel wget make

cd /usr/src

wget https://www.python.org/ftp/python/3.10.14/Python-3.10.14.tgz

tar xzf Python-3.10.14.tgz

cd Python-3.10.14

./configure --enable-optimizations

make -j$(nproc)

make altinstall检查:

python3.10 --version

pip3.10 --version二、在项目里创建虚拟环境(强烈建议)

cd /home/wwwroot/openclaw.cxhao.com/CowAgent

python3.10 -m venv .venv

source .venv/bin/activate升级打包工具:

python -m pip install -U pip setuptools wheel安装依赖:

pip install -r requirements.txt现在系统很多工具可能依赖 Python 3.6,不要把 /usr/bin/python3 硬切换。

项目内用 .venv 最稳妥。

记得都在激活 `.venv` 后执行。

评论(0)